Le café bondé : utiliser les chatbots en toute sécurité avec les données de l'entreprise

Imaginez que vous discutez d'un projet d'entreprise top secret avec un collègue. Le feriez-vous en criant dans un café bondé ? Bien sûr que non. Vous n'avez aucune idée de qui écoute, de ce qu'ils pourraient mal comprendre ou de la façon dont ils pourraient utiliser ces informations ultérieurement.

L'utilisation d'un chatbot IA public pour des travaux sensibles est très similaire. Lorsque vous entrez des informations, vous avez une conversation avec un système énorme et complexe. La question essentielle est la suivante : qu'advient-il de votre conversation une fois qu'elle est terminée ? Par défaut, certaines entreprises d'IA peuvent utiliser les conversations que vous avez sur leurs outils publics pour perfectionner leurs modèles. Bien que cela les aide à améliorer leur IA, cela représente un risque énorme si votre conversation contient des informations confidentielles.

Prendre le contrôle : comment protéger vos conversations

Heureusement, les principales entreprises d'intelligence artificielle comprennent cette préoccupation et vous ont fourni un outil puissant pour protéger votre vie privée. La fonctionnalité de sécurité la plus importante qu'ils offrent est la possibilité de désactiver l'entraînement sur vos données. Cela garantit que vos conversations restent privées et ne sont pas réinjectées dans le modèle pour l'apprentissage futur.

Votre liste de contrôle de sécurité : 3 étapes simples

Avant d'utiliser un chatbot pour le travail, procédez comme suit.

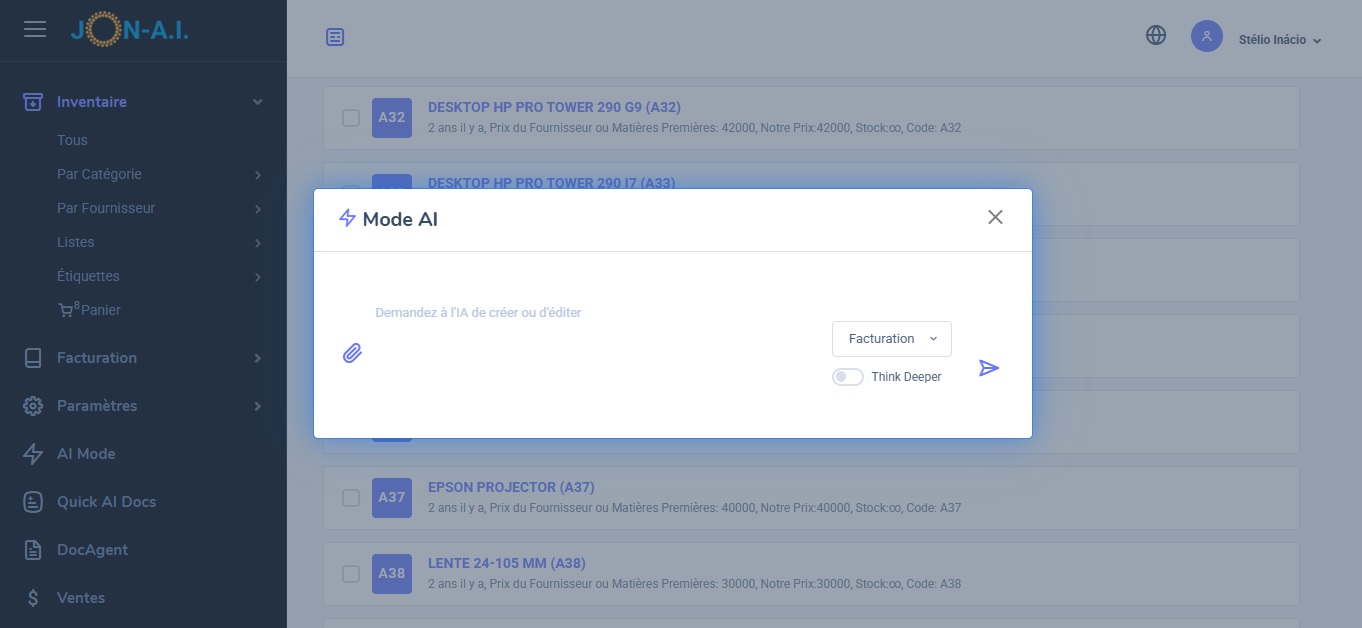

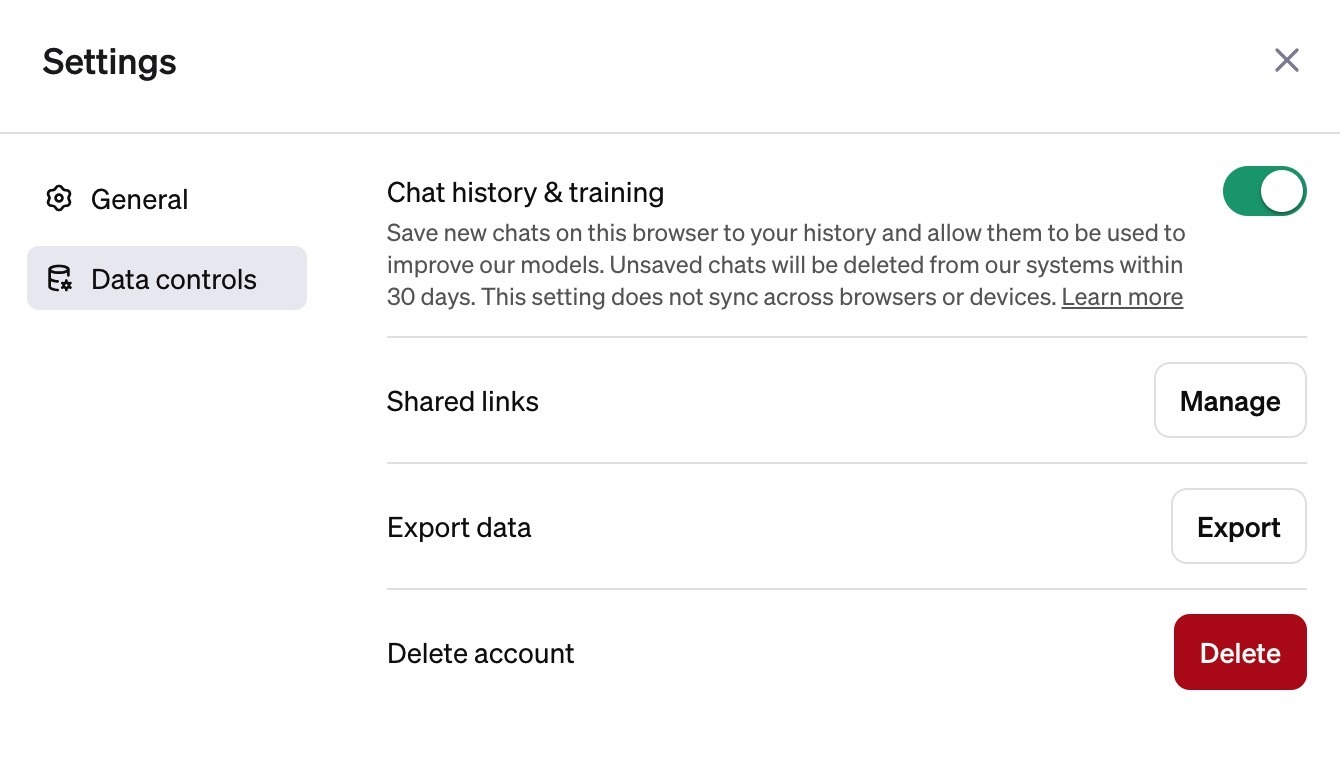

- Trouvez les paramètres « Contrôles des données » ou « Confidentialité ». Dans l'interface de votre chatbot (qu'il s'agisse de ChatGPT, Gemini ou Claude), recherchez le menu des paramètres. À l'intérieur, vous trouverez des options pour gérer vos données.

- Désactivez « Historique des discussions et formation des modèles ». Il s'agit d'une étape cruciale. Cette option, ou une option portant un nom similaire, indique deux choses à la société d'intelligence artificielle : « Ne pas enregistrer l'historique de mes conversations » et « Ne pas utiliser cette conversation pour entraîner vos modèles ». Les trois principales plateformes (ChatGPT, Gemini et Claude) offrent cette fonctionnalité. Pour ChatGPT, il s'agit d'une fonctionnalité réservée aux abonnés payants.

- Pour une utilisation à l'échelle de l'entreprise, insistez sur un plan « Enterprise ». Si votre équipe ou votre entreprise utilise l'IA, la meilleure pratique consiste à utiliser un plan commercial ou d'entreprise dédié. Ces abonnements sont conçus pour une utilisation en entreprise et sont assortis de politiques intégrées de sécurité, de confidentialité et de traitement des données beaucoup plus strictes par défaut.

Aide visuelle : le bouton de confidentialité

Vous devez cliquer sur ce bouton pour qu'il soit grisé en position « OFF ».

Contrôle rapide

Quelle est l'étape la plus importante à suivre dans les paramètres de votre chatbot avant de l'utiliser pour un brainstorming sensible lié au travail ?

Récapitulatif : Comment utiliser les chatbots en toute sécurité avec les données de l'entreprise

Ce que nous avons abordé :

- L'utilisation de chatbots publics avec des données confidentielles est risquée, car vos conversations pourraient être utilisées pour la formation de modèles d'IA.

- L'étape de sécurité la plus critique consiste à accéder à vos paramètres et à désactiver l'historique des discussions et la formation des modèles.

- Les trois principales plateformes (ChatGPT, Gemini, Claude) fournissent cette fonctionnalité de confidentialité cruciale.

- Pour une utilisation officielle en entreprise, optez toujours pour un plan d'entreprise sécurisé.

Pourquoi c'est important :

- La protection des informations confidentielles est une responsabilité fondamentale. Savoir comment utiliser ces outils en toute sécurité vous permet de tirer parti de leur puissance sans créer de risques pour votre sécurité ou celle de votre entreprise.

Prochaine étape :

- Nous apprendrons comment rendre les chatbots encore plus puissants et personnels en utilisant des « instructions personnalisées ».