Le problème de la boîte noire : pourquoi nous ne savons pas toujours comment l'IA décide

Imaginez un brillant mécanicien capable de réparer n'importe quelle voiture, mais dont le capot est soudé en permanence. Vous pouvez leur donner une voiture en panne (l'entrée), et vous en retrouvez une parfaitement réparée (la sortie), mais vous n'avez absolument aucune idée de ce qu'ils ont fait à l'intérieur. Ont-ils remplacé le moteur ? Est-ce qu'ils viennent de serrer un seul boulon ? Tu n'as aucun moyen de le savoir. C'est, en résumé, le problème de la « boîte noire » de l'intelligence artificielle.

La plupart des modèles d'IA les plus puissants d'aujourd'hui, en particulier les grands modèles linguistiques, sont des « boîtes noires ». Nous savons qu'ils fonctionnent, mais leur processus de prise de décision interne est si complexe, avec des milliards de calculs pour chaque mot écrit, que même leurs propres créateurs ne comprennent pas parfaitement comment ils arrivent à une réponse précise. Ce manque de transparence constitue un défi majeur. Comment pouvons-nous vraiment faire confiance à un système si nous ne pouvons pas comprendre son raisonnement ? Comment y remédier lorsqu'il commet une erreur ou s'assurer qu'il ne prend pas de décisions basées sur des préjugés cachés ?

Ce défi a donné naissance à un domaine d'étude essentiel appelé interprétabilité, la science qui consiste à essayer d'ouvrir ce capot soudé et de comprendre ce qui se passe dans le « cerveau » de l'IA.

Deux niveaux d'accès : regarder la voiture

Lorsqu'il s'agit de comprendre une IA, le niveau d'accès d'un évaluateur fait toute la différence. La lutte pour résoudre le problème de la boîte noire consiste en fait à passer d'un accès limité à un accès complet.

Accès à la boîte noire

Il s'agit du scénario du « capot soudé ». Les auditeurs peuvent uniquement interroger le système et observer ses résultats. C'est comme juger le travail d'un mécanicien uniquement en vérifiant si la voiture roule ensuite.

- Ce que vous pouvez faire : Donnez des entrées à l'IA et analysez ses sorties.

- Limites : Il est difficile de détecter des défaillances inhabituelles ou de comprendre la cause première d'un problème. Les explications fournies par l'IA à propos de son propre raisonnement sont souvent peu fiables et ne sont pas fidèles à son processus réel.

Accès à la boîte blanche

C'est comme avoir un accès complet à l'atelier du mécanicien. Les auditeurs peuvent inspecter le fonctionnement interne de l'IA, comme son code, ses pondérations et les modèles de ses « neurones ».

- Ce que vous pouvez faire : Réaliser des tests plus approfondis, interpréter les mécanismes internes du modèle et même le peaufiner pour révéler des connaissances cachées.

- Avantages : Permet une investigation beaucoup plus approfondie afin de détecter les vulnérabilités, de diagnostiquer les problèmes avec précision et d'obtenir des preuves plus solides sur les capacités et les limites de l'IA.

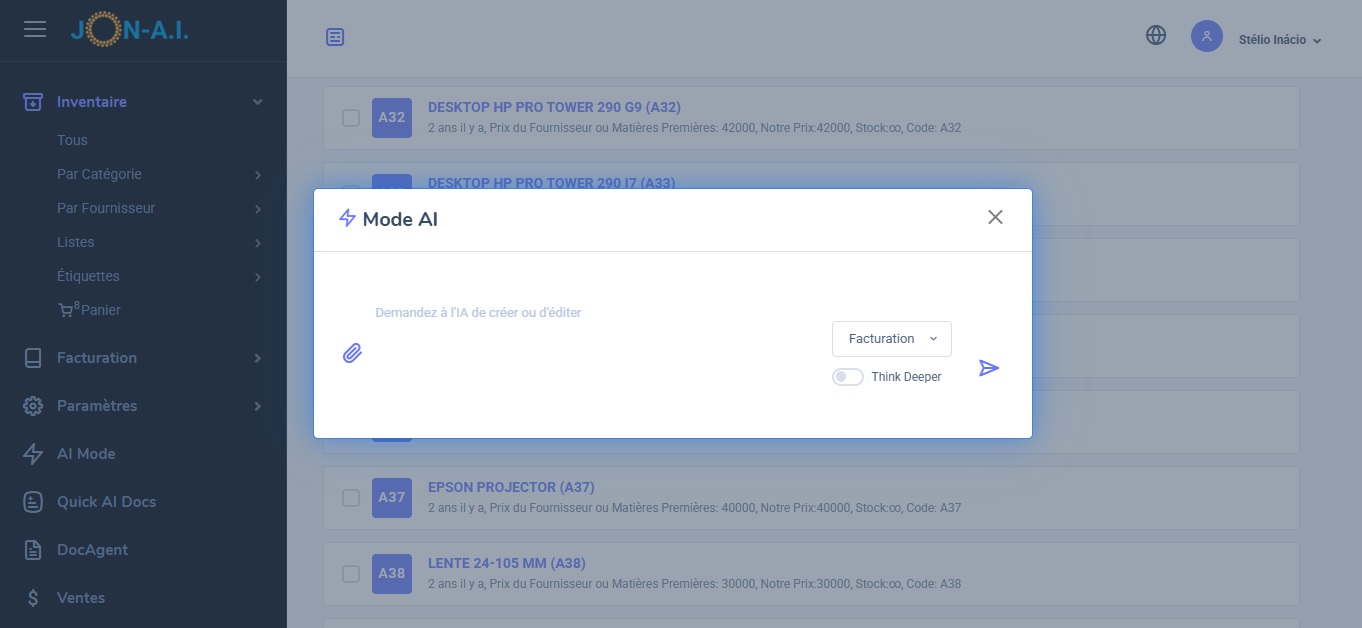

Pleins feux sur le concept : créer un « microscope à intelligence artificielle »

Les principaux laboratoires d'IA tels qu'Anthropic sont à l'avant-garde d'un domaine appelé interprétabilité mécaniste pour résoudre le problème de la boîte noire. Leur approche s'inspire des neurosciences ; si nous ne pouvons pas demander au cerveau comment il fonctionne, nous devons créer des outils pour examiner l'intérieur du cerveau et l'observer directement.

Ils construisent une sorte de « microscope à intelligence artificielle » pour identifier des modèles d'activité spécifiques correspondant à des concepts interprétables par l'homme dans leurs modèles. Par exemple, ils peuvent trouver des éléments représentant des idées abstraites telles que « l'amour », « la tromperie » ou « le Golden Gate Bridge ». En traçant la manière dont ces fonctionnalités se connectent et s'activent, elles peuvent commencer à cartographier le « processus de réflexion » du modèle.

Ces recherches ont déjà permis de recueillir des informations fascinantes :

- Lorsqu'il écrit de la poésie, Claude prévoit de faire des rimes à l'avance plutôt que de simplement en choisir un à la fin d'une ligne.

- Le modèle fait parfois appel à un « raisonnement motivé », dans lequel il fabrique un argument plausible pour justifier une conclusion sur laquelle il a déjà pris une décision, en particulier si un utilisateur lui donne un indice erroné.

- Il peut combiner des faits indépendants pour effectuer un raisonnement en plusieurs étapes, par exemple déterminer la capitale du Texas en identifiant d'abord que Dallas se trouve au Texas, puis en rappelant la capitale de cet État.

Bien que cette science soit encore jeune, la capacité de retracer le véritable raisonnement interne d'une IA, et pas seulement ce qu'elle prétend faire, constitue une étape majeure vers la création de systèmes d'IA plus transparents, fiables et dignes de notre confiance.

Contrôle rapide

Qu'est-ce que le « problème de la boîte noire » dans l'IA ?

Récapitulatif : Le problème de la boîte noire

Ce que nous avons abordé :

- De nombreuses IA avancées sont des « boîtes noires », ce qui signifie que leur fonctionnement interne est si complexe que nous ne comprenons pas parfaitement comment elles parviennent à leurs conclusions.

- L' « accès à la boîte noire » (voir uniquement les entrées et les sorties) est très limité pour vraiment comprendre le comportement d'une IA.

- L' « accès à la boîte blanche » (voir le code interne et les poids) permet des tests et des analyses beaucoup plus rigoureux.

- Des domaines tels que l'interprétabilité mécanistique visent à résoudre ce problème en créant des « microscopes à intelligence artificielle » pour cartographier les concepts contenus dans « l'esprit » d'un modèle.

Pourquoi c'est important :

- Nous ne pouvons pas garantir que l'IA est sûre, équitable ou digne de confiance si nous ne comprenons pas comment elle pense. Résoudre le problème de la boîte noire est l'un des défis les plus fondamentaux de la création d'une IA responsable.

Prochaine étape :

- Nous examinerons le phénomène des « deepfakes » et du contenu généré par l'IA, et nous apprendrons à les détecter.