Législation comparée en matière d'IA : toute une différence

Comme nous l'avons vu, l'intelligence artificielle n'est pas une technologie comme les autres ; c'est une « technologie polyvalente », une force fondamentale comme la machine à vapeur ou l'électricité, capable de remodeler notre monde. En raison de son impact si profond, un consensus mondial s'est dégagé sur le fait qu'il doit être réglementé. Mais la question cruciale n'est plus de savoir s'il faut réglementer l'IA, mais *comment*.

Cela a déclenché une course mondiale pour rédiger les règles de l'IA, une course aux enjeux philosophiques profonds. Les cadres juridiques conçus aujourd'hui ne sont pas simplement des documents techniques ; ils reflètent avec force les principes fondamentaux d'une nation et sa vision de l'avenir. Lorsque nous examinons le monde entier, nous constatons que le paysage se fragmente selon des lignes philosophiques distinctes, avec l'émergence de trois « pôles » principaux de gouvernance : l'Union européenne fondée sur les droits, les États-Unis axés sur l'innovation et la République populaire de Chine contrôlée par l'État.

Les trois pôles de la gouvernance de l'IA

1. L'Union européenne : le régulateur complet fondé sur les droits

L'UE s'est positionnée comme le régulateur de l'aluminium le plus complet au monde grâce à sa loi historique sur l'IA. Ce cadre juridiquement contraignant donne la priorité à la protection des droits fondamentaux, de la sécurité et des valeurs démocratiques avant tout. L'essence de la Loi est une approche à plusieurs niveaux, fondée sur les risques, qui classe tous les systèmes en fonction de leur potentiel nocif :

- Risque inacceptable : Ces systèmes sont purement et simplement interdits. Cela inclut l'IA pour la notation sociale dirigée par le gouvernement, les techniques subliminales de manipulation et la plupart des utilisations de la reconnaissance faciale en temps réel en public par les forces de l'ordre.

- Risque élevé : il s'agit de la catégorie la plus réglementée, couvrant l'IA utilisée dans des domaines critiques tels que l'emploi, l'éducation, l'application de la loi et l'accès à des services essentiels tels que la notation de crédit. Les fournisseurs de ces systèmes sont soumis à des obligations strictes, notamment en matière de gestion des risques, de gouvernance des données de haute qualité, de supervision humaine et de documentation technique complète avant que leur produit ne puisse être vendu.

- Risque limité : ces systèmes, comme les chatbots ou les deepfakes, sont soumis à des obligations de transparence, ce qui signifie que les utilisateurs doivent être informés qu'ils interagissent avec une IA ou qu'ils consultent du contenu synthétique.

- Risque minimal : La grande majorité des systèmes d'IA (par exemple, les filtres anti-spam, l'IA dans les jeux vidéo) sont concernés et ne sont soumis à aucune nouvelle obligation légale.

En imposant des amendes massives pouvant atteindre 7 % du chiffre d'affaires mondial d'une entreprise en cas de non-conformité, l'UE entend utiliser son pouvoir de marché pour exporter ces règles à l'échelle mondiale, une stratégie connue sous le nom d' « effet Bruxelles ».

2. Les États-Unis : un patchwork favorable à l'innovation et axé sur le marché

À l'opposé, les États-Unis défendent une philosophie « pro-innovation » axée sur le marché, conçue pour maintenir leur leadership mondial dans le domaine de l'IA. Il a délibérément évité une loi unique et globale, au lieu de créer un « patchwork » de politiques dynamiques, flexibles et parfois incertaines. L'approche américaine repose sur deux piliers :

- Leadership exécutif : La politique fédérale en matière d'IA est largement dictée par les décrets, qui peuvent changer radicalement à chaque nouveau président. Par exemple, le décret 14110 de l'administration Biden sur « une intelligence artificielle sûre, sécurisée et fiable » a ensuite été annulé et recentré par le décret 14179 de l'administration Trump, qui mettait l'accent sur la compétitivité et éliminait les « préjugés idéologiques ». Cette volatilité crée une incertitude réglementaire pour les entreprises.

- Le cadre de gestion des risques liés à l'IA (RMF) du NIST : il s'agit de la pierre angulaire technique de l'approche américaine. Essentiellement, le RMF est un cadre volontaire. Il fournit des conseils aux entreprises pour gérer les risques liés à l'IA en suivant quatre fonctions : gouverner, cartographier, mesurer et gérer. Cela repose sur les entreprises et les régulateurs sectoriels existants (tels que la FTC et la FDA) pour appliquer les règles, plutôt que sur une nouvelle autorité centrale en matière d'IA.

3. Chine : le cadre centré sur l'État et axé sur le contrôle

L'approche de la Chine est un modèle unique d' « autoritarisme agile », conçu pour atteindre le double objectif de suprématie technologique et de stabilité sociale et politique absolue. Au lieu d'une seule grande loi, la Chine a mis en place une série de réglementations rapides et ciblées pour des technologies spécifiques au fur et à mesure de leur émergence. Les principales réglementations incluent les règles relatives à la « synthèse profonde » (deepfakes) et à l'IA générative. Le cœur de ce cadre est le contrôle de l'État :

- Contrôle du contenu et de l'idéologie : les fournisseurs sont légalement tenus de s'assurer que tout contenu généré par l'IA respecte les « valeurs fondamentales socialistes » et ne met pas en danger la sécurité nationale ni ne porte atteinte à l'image de la nation. Cela interdit de fait les applications d'intelligence artificielle qui pourraient être utilisées à des fins de dissidence politique.

- Registre des algorithmes et évaluations de sécurité : Le processus de dépôt obligatoire est un outil clé du contrôle de l'État. Les services d'intelligence artificielle dotés « d'attributs liés à l'opinion publique ou de capacités de mobilisation sociale » doivent faire l'objet d'une évaluation de sécurité et déposer leurs algorithmes auprès de l'Administration chinoise du cyberespace (CAC) avant leur lancement. Cela donne à l'État une vision et un contrôle inégalés.

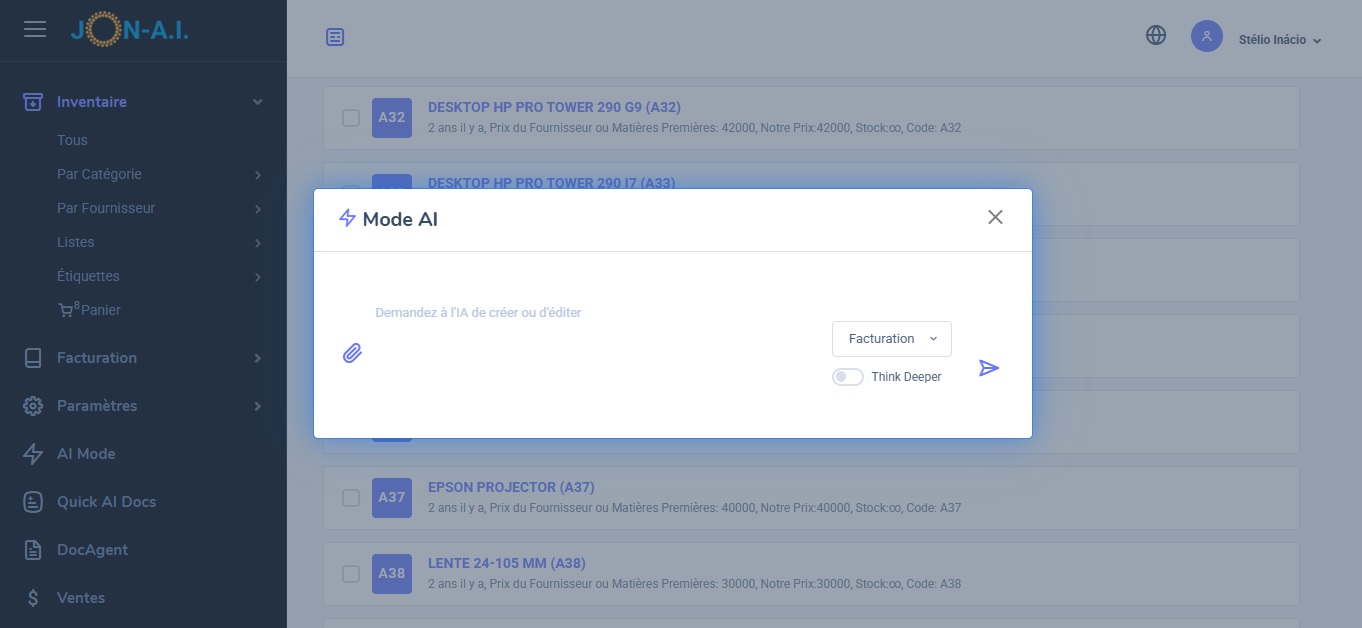

En un coup d'œil : comparaison des cadres d'IA mondiaux

Les différentes approches philosophiques se traduisent par des systèmes réglementaires très différents.

| Fonctionnalité | Union européenne | États-Unis | Chine |

|---|---|---|---|

| Statut légal | Loi contraignante (Loi sur l'IA) | Cadre fédéral volontaire ; patchwork de lois étatiques/sectorielles | Lois contraignantes (réglementations ciblées) |

| Philosophie de base | Fondé sur les droits, précaution | Axé sur le marché et favorable à l'innovation | Centré sur l'état, orienté vers le contrôle |

| Corps principal | Bureau de l'IA de l'UE et autorités nationales | Régulateurs sectoriels existants (FTC, FDA, etc.) | Administration chinoise du cyberespace (CAC) |

| Approche du risque | Niveaux de risque prescriptifs (inacceptable, élevé, etc.) | Gestion volontaire des risques basée sur le contexte | Ciblé par application ; accent sur la sécurité de l'État |

| Mécanisme de contrôle des clés | Évaluations de conformité avant la mise sur le marché pour l'IA à haut risque. | Exécution a posteriori (après coup) sur la base des lois existantes. | Évaluations de sécurité préalables à la mise en marché et registre des algorithmes. |

Contrôle rapide

Quelle juridiction a adopté une approche globale, juridiquement contraignante et basée sur le risque qui interdit purement et simplement certaines pratiques liées à l'IA, comme le score social ?

Récapitulatif : Législation comparée sur l'IA

Ce que nous avons abordé :

- Le monde se divise en trois « pôles » réglementaires principaux pour l'IA, chacun reflétant des valeurs fondamentales différentes.

- L'UE dispose d'une loi complète fondée sur les droits (la loi sur l'IA) qui classe l'IA en fonction des risques et interdit certaines applications.

- Les États-Unis ont adopté une approche « disparate » axée sur l'innovation et axée sur le marché, qui repose sur des cadres volontaires et des régulateurs sectoriels existants.

- La Chine utilise un modèle d' « autoritarisme agile » centré sur l'État, mettant en œuvre des lois ciblées et contraignantes axées sur le contrôle du contenu et la stabilité sociale.

Pourquoi c'est important :

- Cette divergence réglementaire mondiale crée un environnement complexe et difficile pour les entreprises. Les règles rédigées aujourd'hui détermineront non seulement l'avenir de la technologie, mais également l'avenir du commerce international et de l'alignement géopolitique à l'ère numérique.

Prochaine étape :

- Regardons ensuite « Ressources : rester à jour dans un monde de l'IA en évolution rapide »