L'éthique de l'IA : équilibre entre innovation et responsabilité

Bienvenue dans un nouveau chapitre, peut-être le plus important de notre voyage. Jusqu'à présent, nous avons été émerveillés par ce que l'IA peut faire. Maintenant, nous devons nous poser une question plus profonde : devrions-nous faire quelque chose simplement parce que nous pouvons faire quelque chose avec l'IA ?

C'est le cœur de l'éthique de l'IA. Il s'agit d'un grand équilibre entre le rythme effréné de l'innovation et le poids immense de la responsabilité. D'une part, l'IA offre des possibilités époustouflantes : guérir les maladies, résoudre le problème du changement climatique et ouvrir de nouvelles frontières en matière de créativité. L'envie d'innover est une course pour résoudre les plus grands problèmes de l'humanité.

D'un autre côté, toute technologie puissante comporte des risques. Une IA conçue pour personnaliser le contenu peut également être utilisée pour manipuler les opinions. Une IA capable d'écrire du code peut également être utilisée pour créer des logiciels malveillants. Notre responsabilité est de veiller à ce que, dans notre course à la construction d'un avenir meilleur, nous ne créions pas accidentellement de nouveaux dangers imprévus. Il ne s'agit pas d'arrêter le progrès, mais de le gérer avec sagesse et clairvoyance.

Les deux faces de la médaille éthique

Le développement de l'IA est une négociation constante entre deux forces puissantes, souvent concurrentes.

L'attrait de l'innovation

Il s'agit de la volonté de créer une technologie plus puissante, plus performante et capable de changer le monde le plus rapidement possible.

- Objectif : résoudre des problèmes majeurs, ouvrir de nouveaux marchés et repousser les limites de la science.

- Motivation : le potentiel d'un impact positif immense, d'un avantage concurrentiel et de découvertes scientifiques.

- Devise : « Déplacez-vous vite et construisez des choses ».

- Risque : Peut négliger les conséquences négatives potentielles de la course pour la première place.

Le poids de la responsabilité

C'est le devoir de faire une pause, de réfléchir et de veiller à ce que la technologie que nous développons soit sûre, équitable et bénéfique pour toute l'humanité.

- Objectif : Prévenir les préjudices, garantir l'équité, protéger la vie privée et maintenir le contrôle humain.

- Motivation : engagement en faveur des valeurs humaines, du bien social et de la stabilité à long terme.

- Devise : « D'abord, ne pas nuire ».

- Risque : Une approche trop prudente pourrait ralentir les progrès susceptibles de sauver des vies ou de résoudre des problèmes urgents.

Pleins feux sur le concept : Qui est responsable ? Un devoir partagé

Qui est donc réellement chargé de veiller à ce que l'IA soit éthique ? La réponse est qu'il s'agit d'une responsabilité partagée entre plusieurs groupes :

- Les développeurs (entreprises et ingénieurs) : Ils sont en première ligne. Leur responsabilité est d'intégrer des considérations de sécurité et d'éthique directement dans la conception de l'IA, de faire preuve de transparence quant à ses limites et de la tester rigoureusement pour détecter tout danger potentiel avant de la lancer.

- Les décideurs (gouvernements) : Leur rôle est de créer des règles de la route (lois et règlements) qui fixent des limites claires à ce qui est acceptable. Ils doivent protéger les citoyens contre tout préjudice sans entraver les innovations bénéfiques.

- Le public (nous tous) : En tant qu'utilisateurs de l'IA, nous avons la responsabilité de faire preuve d'esprit critique. Nous devons comprendre les bases du fonctionnement de l'IA, remettre en question les informations qu'elle nous fournit et défendre le type de monde alimenté par l'IA dans lequel nous voulons vivre.

L'IA éthique n'est pas un problème qu'un seul groupe peut résoudre seul. Cela nécessite un dialogue constant et ouvert entre les créateurs, les régulateurs et le public.

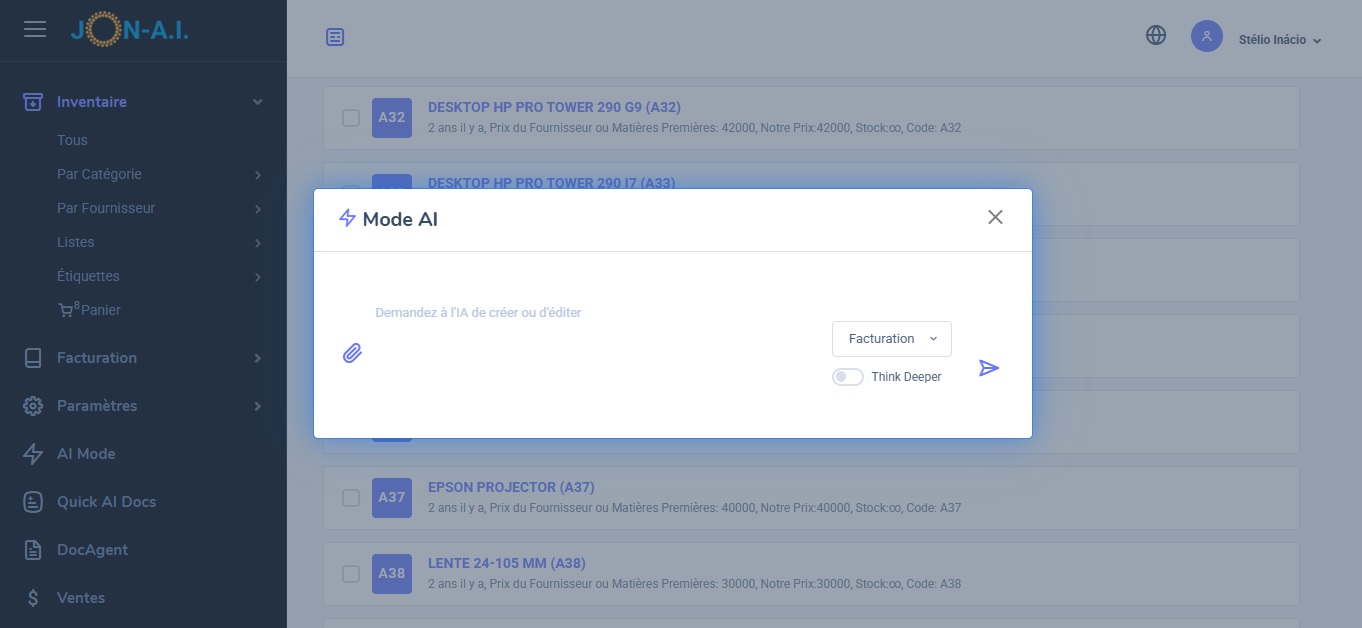

Concept clé : Agents d'IA : augmentation ou remplacement ?

Un débat éthique fondamental autour des agents de l'IA porte sur la question de savoir s'ils excluent l'humain de la boucle. Sont-ils là pour augmenter nos capacités ou pour nous remplacer ? Sont-ils conçus pour nous aider à prendre de meilleures décisions, ou pour prendre des décisions à notre place ? Sont-ils destinés à nous aider à devenir plus productifs ou simplement à être plus productifs que nous ?

Tenez compte de la différence. Un agent d'intelligence artificielle qui effectue des recherches approfondies est un outil incroyablement utile qui nous permet d'apprendre plus rapidement. Il est difficile d'imaginer abandonner un assistant aussi puissant. Mais qu'en est-il d'un agent marketing totalement autonome, conçu pour remplacer complètement le responsable du marketing ? C'est là que la dynamique change. Un tel agent n'augmente pas les capacités humaines ; il prend simplement le travail d'un humain. Cela met en évidence la tension centrale qui règne dans le développement de l'IA : créons-nous des outils pour aider l'humanité ou construisons-nous des systèmes qui rendent certains rôles humains obsolètes ?

Aide visuelle : l'apocalypse de l'IA est-elle inévitable ?

Tristan Harris explore les deux voies les plus probables que suivra l'IA, l'une menant au chaos et l'autre à la dystopie. Il explique comment nous pouvons suivre un chemin étroit entre ces 2 résultats indésirables.

Contrôle rapide

Quel est le conflit fondamental au cœur de l'éthique de l'IA ?

Récapitulatif : L'éthique de l'IA

Ce que nous avons abordé :

- L'éthique de l'IA est le défi crucial qui consiste à trouver un équilibre entre la volonté d'innover et la responsabilité de protéger les valeurs humaines.

- L' « attrait de l'innovation » vise des progrès rapides, tandis que le « poids de la responsabilité » donne la priorité à la sécurité, à l'équité et à la prévention des dommages.

- Il s'agit d'une responsabilité partagée entre les développeurs d'IA, les décideurs gouvernementaux et le public.

Pourquoi c'est important :

- Il s'agit sans doute de la conversation la plus importante sur la technologie au 21e siècle. Les choix éthiques que nous faisons aujourd'hui façonneront le monde dont nos enfants et petits-enfants hériteront.

Prochaine étape :

- Nous explorerons un aspect fascinant et troublant de l'éthique de l'IA connu sous le nom de « problème de la boîte noire ».