The Crowded Coffee Shop: usando chatbots com segurança com dados da empresa

Imagine que você está discutindo um projeto ultrassecreto da empresa com um colega. Você faria isso gritando em uma cafeteria lotada? Claro que não. Você não tem ideia de quem pode estar ouvindo, o que eles podem entender mal ou como eles podem usar essas informações mais tarde.

Usar um chatbot público de IA para trabalhos confidenciais é muito semelhante. Quando você insere informações, está conversando com um sistema enorme e complexo. A questão crítica é: o que acontece com sua conversa depois que ela termina? Por padrão, algumas empresas de IA podem usar as conversas que você tem em suas ferramentas públicas para treinar ainda mais seus modelos. Embora isso os ajude a melhorar sua IA, representa um grande risco se sua conversa contiver informações confidenciais.

Assumindo o controle: como proteger suas conversas

Felizmente, as principais empresas de IA entendem essa preocupação e forneceram uma ferramenta poderosa para você proteger sua privacidade. O recurso de segurança mais importante que eles oferecem é a capacidade de desativar o treinamento em seus dados. Isso garante que suas conversas permaneçam privadas e não sejam inseridas no modelo de aprendizado futuro.

Sua lista de verificação de segurança: 3 etapas simples

Antes de usar qualquer chatbot para trabalhar, siga estas etapas.

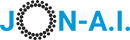

- Encontre as configurações de “Controles de dados” ou “Privacidade”. Na interface do seu chatbot (seja ChatGPT, Gemini ou Claude), procure o menu de configurações. Lá dentro, você encontrará opções para gerenciar seus dados.

- Desative o “Histórico de bate-papo e treinamento de modelos”. Essa é a etapa crucial. Essa opção, ou uma com um nome semelhante, diz à empresa de IA duas coisas: “Não salve meu histórico de conversas” e “Não use essa conversa para treinar seus modelos”. Todas as três principais plataformas — ChatGPT, Gemini e Claude — oferecem esse recurso. Para o ChatGPT, esse é um recurso para assinantes pagos.

- Para uso em toda a empresa, insista em um plano “empresarial”. Se sua equipe ou empresa estiver usando IA, a melhor prática é usar um plano empresarial ou empresarial dedicado. Essas assinaturas são criadas para uso corporativo e, por padrão, vêm com políticas de segurança, privacidade e tratamento de dados muito mais rígidas e integradas.

Auxílio visual: o botão de privacidade

Você deve clicar nesse botão para que fique acinzentado na posição “OFF”.

Verificação rápida

Qual é a etapa mais importante que você deve realizar nas configurações do seu chatbot antes de usá-lo para qualquer brainstorming confidencial relacionado ao trabalho?

Recapitulando: Como usar chatbots de forma segura com os dados da empresa

O que abordamos:

- Usar chatbots públicos com dados confidenciais é arriscado porque suas conversas podem ser usadas para treinamento de modelos de IA.

- A etapa de segurança mais importante é acessar suas configurações e desativar o histórico de bate-papo e o treinamento de modelos.

- Todas as três principais plataformas (ChatGPT, Gemini, Claude) fornecem esse recurso crucial de privacidade.

- Para uso oficial da empresa, sempre opte por um plano seguro de nível empresarial.

Por que isso importa:

- Proteger informações confidenciais é uma responsabilidade fundamental. Saber como usar essas ferramentas com segurança permite que você aproveite o poder delas sem criar riscos de segurança para você ou sua empresa.

A seguir:

- Aprenderemos como tornar os chatbots ainda mais poderosos e pessoais usando “instruções personalizadas”.