La Inteligencia Artificial ofrece un potencial transformador, pero su rápida adopción en el mundo empresarial ha superado la comprensión crítica de sus riesgos. Implementar la IA sin una estrategia clara para mitigar sus peligros no es solo negligente; es una amenaza directa para la seguridad, la reputación y los resultados de su empresa. Este artículo describe los tres peligros más significativos y cómo protegerse de ellos.

Peligro 1: Fugas de Propiedad Intelectual y Seguridad de Datos

El peligro más inmediato y generalizado del uso de la IA proviene de un malentendido fundamental sobre cómo funcionan muchos modelos de IA. La IA generativa aprende de vastos conjuntos de datos, incluidos los prompts y archivos que los usuarios cargan. Cuando sus empleados usan herramientas de IA públicas y gratuitas, podrían estar alimentando sin saberlo la información más sensible de su empresa a una base de datos global.

¿Cuál es el daño? Imagine que un empleado carga un plan de negocios confidencial o un borrador para una nueva patente en una IA pública para "corregirlo". La IA aprende de estos datos. Semanas después, un competidor, investigando un mercado similar, le pide a la IA ideas para un plan de negocios. La IA, ahora entrenada con su estrategia propietaria, le proporciona a su competidor un plan detallado y bien estructurado basado en su propia propiedad intelectual. Acaba de armar a su competencia con sus mejores ideas.

Este no es un escenario hipotético. A menos que se deshabilite explícitamente, este es el comportamiento predeterminado de muchos servicios de IA. La única defensa verdadera es una combinación de herramientas de IA privadas de nivel empresarial y, lo más importante, una fuerza laboral capacitada para comprender que sus prompts no son conversaciones privadas. Deben saber cómo deshabilitar el entrenamiento del modelo en cada herramienta que utilizan.

Peligro 2: Catástrofes de IA por "Alucinaciones"

Los modelos de IA no son motores de búsqueda; son motores de predicción. Están diseñados para generar texto plausible, no para afirmar verdades objetivas. Cuando una IA no sabe una respuesta, a menudo "alucina", un término educado para "inventar cosas". Dado que el resultado fabricado suele estar bien escrito y es convincente, es peligrosamente fácil de creer.

Estas alucinaciones han provocado catástrofes en el mundo real:

- Negligencia Profesional Jurídica: Abogados que representaban a un cliente contra Avianca Airlines utilizaron una IA para investigación legal. Esta inventó precedentes legales falsos, que los abogados presentaron ante un tribunal federal. El caso fue desestimado y los abogados fueron multados y avergonzados públicamente por negligencia grave.

- Desinformación Financiera: El sitio de noticias tecnológicas CNET utilizó una IA para escribir docenas de artículos financieros. Los artículos contenían errores matemáticos básicos y contenido plagiado, lo que obligó a CNET a emitir humillantes correcciones públicas, dañando gravemente su credibilidad.

- Promesas Falsas Vinculantes: Air Canada fue obligada por un tribunal a cumplir una política de reembolso que su propio chatbot había inventado, sentando un precedente legal de que las empresas son responsables de las promesas que hacen sus IAs, sean ciertas o no.

Un solo "hecho" no verificado de una IA puede llevar a decisiones comerciales desastrosas, responsabilidad legal y un daño irreparable a la reputación.

Peligro 3: Erosión de la Calidad y la Reputación de la Marca

Más allá de las catástrofes puntuales, un peligro sutil pero corrosivo del uso no capacitado de la IA es la erosión gradual de la calidad. Cuando los empleados confían en la IA como una muleta en lugar de una herramienta, la calidad de su producción puede disminuir. Los resultados suelen ser genéricos, robóticos y carentes de la perspicacia humana.

Gannett, una de las editoriales de periódicos más grandes de EE. UU., aprendió esto por las malas cuando utilizó una IA para escribir resúmenes de deportes de secundaria. Los artículos eran tan cómicamente malos —usando frases como "encuentro de tipo atlético"— que se convirtieron en el hazmerreír nacional. La empresa alienó a los lectores locales y tuvo que detener el programa, sufriendo un duro golpe a su reputación periodística.

Si los informes, el texto de marketing o las comunicaciones con los clientes de su empresa comienzan a sentirse sin vida y genéricos, está en el camino hacia la irrelevancia de la marca. La IA debe aumentar la experiencia humana, no reemplazarla.

La Solución: Un Cortafuegos Humano

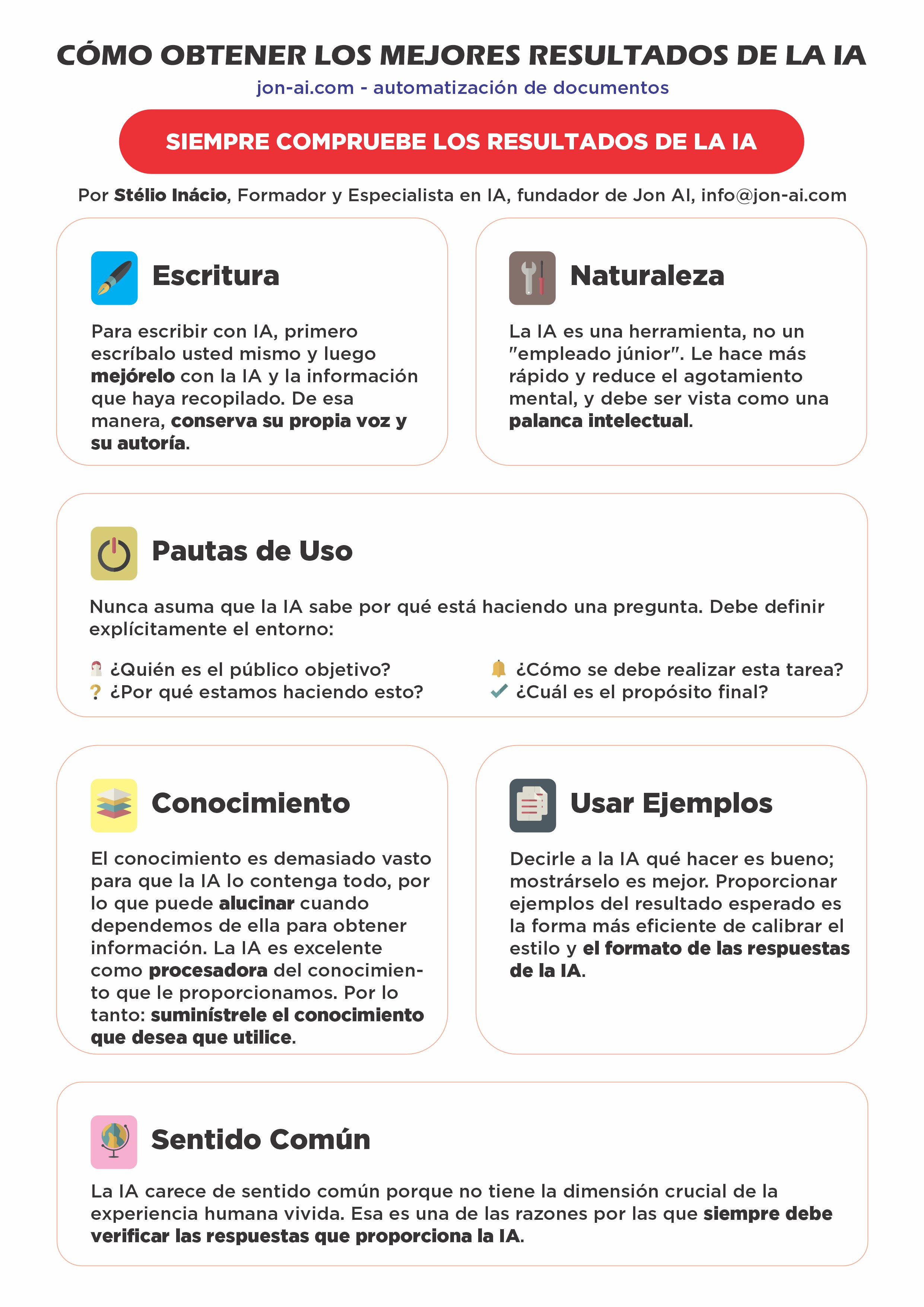

El hilo común en todos estos peligros es el error humano, específicamente, la falta de comprensión de la tecnología. La defensa más eficaz contra los peligros de la IA es un "cortafuegos humano": una fuerza laboral educada, consciente y capacitada para usar la IA de manera segura y eficaz.

Nuestro completo programa de formación está diseñado para construir este cortafuegos. Enseñamos a sus empleados:

- Las reglas innegociables de la seguridad de los datos en la IA.

- Cómo detectar y verificar posibles alucinaciones de la IA.

- Un marco para usar la IA para mejorar la calidad, no para diluirla.

- Los casos de uso específicos en los que la IA es fuerte y en los que debe evitarse.

No espere a que una catástrofe inducida por la IA le haga tomar en serio estos peligros. El momento de formar a su equipo es ahora.

¿Listo para proteger su empresa y convertir el riesgo de la IA en una ventaja competitiva?