A Inteligência Artificial oferece um potencial transformador, mas sua rápida adoção no mundo dos negócios ultrapassou a compreensão crítica de seus riscos. Implementar IA sem uma estratégia clara para mitigar seus perigos não é apenas negligente; é uma ameaça direta à segurança, reputação e resultados financeiros de sua empresa. Este artigo descreve os três perigos mais significativos e como se proteger contra eles.

Perigo 1: Vazamentos de Propriedade Intelectual e Segurança de Dados

O perigo mais imediato e difundido do uso da IA vem de um mal-entendido fundamental de como muitos modelos de IA funcionam. A IA generativa aprende com vastos conjuntos de dados, incluindo os prompts e arquivos que os usuários enviam. Quando seus colaboradores usam ferramentas de IA públicas e gratuitas, eles podem estar inadvertidamente alimentando as informações mais sensíveis de sua empresa em um banco de dados global.

Qual é o problema? Imagine que um colaborador envia um plano de negócios confidencial ou um rascunho de uma nova patente para uma IA pública para "revisá-lo". A IA aprende com esses dados. Semanas depois, um concorrente, pesquisando um mercado semelhante, pede à IA ideias de planos de negócios. A IA, agora treinada em sua estratégia proprietária, fornece ao seu concorrente um plano detalhado e bem estruturado baseado em sua própria propriedade intelectual. Você acabou de armar sua concorrência com suas melhores ideias.

Este não é um cenário hipotético. A menos que seja explicitamente desativado, este é o comportamento padrão de muitos serviços de IA. A única defesa verdadeira é uma combinação de ferramentas de IA privadas de nível empresarial e, o mais importante, uma força de trabalho treinada para entender que seus prompts não são conversas privadas. Eles devem saber como desativar o treinamento do modelo em todas as ferramentas que usam.

Perigo 2: Catástrofes de IA por "Alucinações"

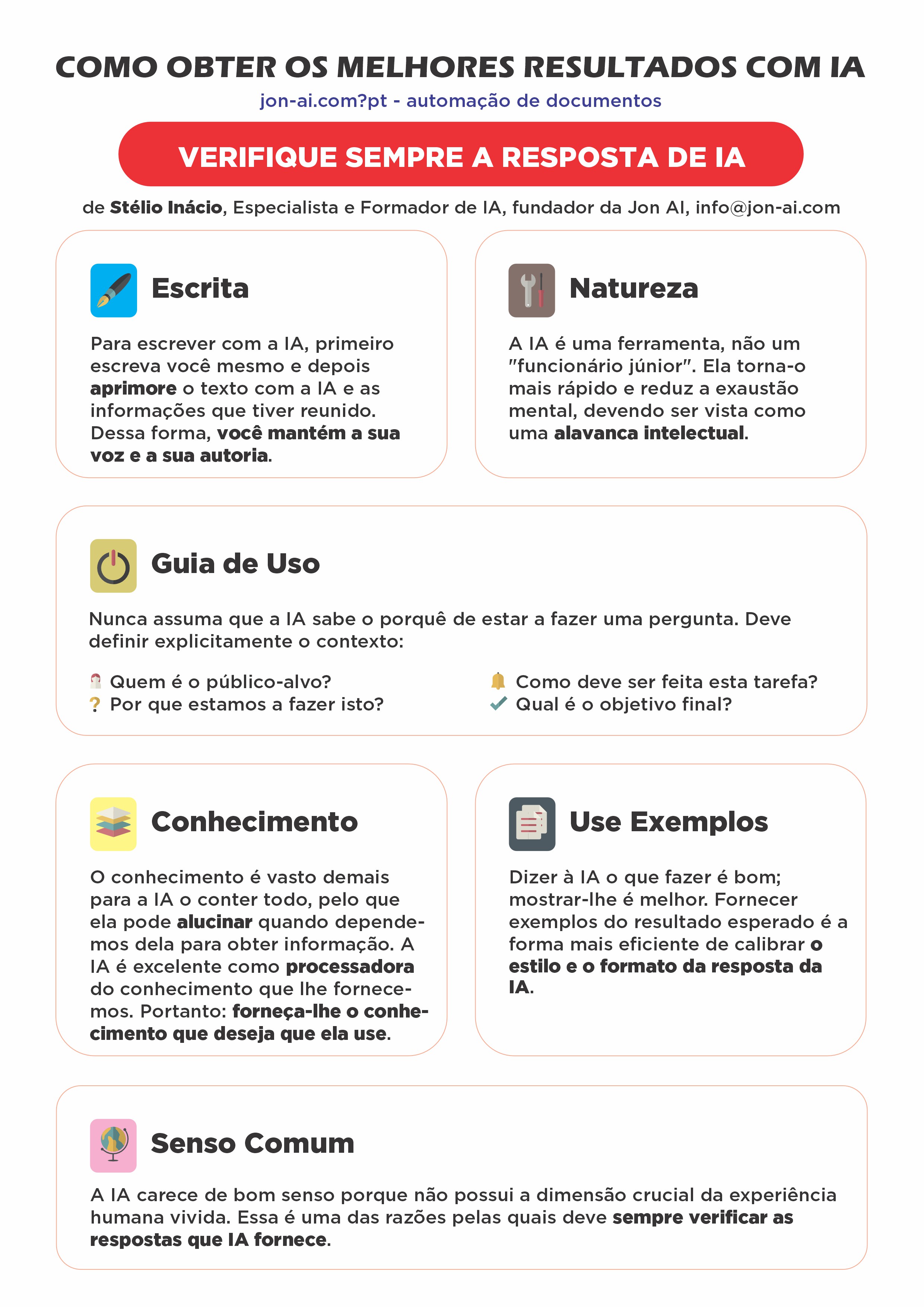

Modelos de IA não são motores de busca; são motores de previsão. Eles são projetados para gerar texto plausível, não para declarar verdades objetivas. Quando uma IA não sabe uma resposta, ela frequentemente "alucina" — um termo educado para "inventar coisas". Como o resultado fabricado geralmente é bem escrito e confiante, é perigosamente fácil de acreditar.

Essas alucinações levaram a catástrofes no mundo real:

- Negligência Jurídica: Advogados representando um cliente contra a Avianca Airlines usaram uma IA para pesquisa jurídica. Ela inventou precedentes legais falsos, que os advogados submeteram a um tribunal federal. O caso foi arquivado, e os advogados foram multados e publicamente envergonhados por negligência grave.

- Desinformação Financeira: O site de notícias de tecnologia CNET usou uma IA para escrever dezenas de artigos financeiros. Os artigos continham erros matemáticos básicos e conteúdo plagiado, forçando a CNET a emitir correções públicas humilhantes e danificando gravemente sua credibilidade.

- Promessas Falsas Vinculativas: A Air Canada foi forçada por um tribunal a honrar uma política de reembolso que seu próprio chatbot havia inventado, estabelecendo um precedente legal de que as empresas são responsáveis pelas promessas que suas IAs fazem, verdadeiras ou não.

Um único "fato" não verificado de uma IA pode levar a decisões de negócios desastrosas, responsabilidade legal e danos irreparáveis à reputação.

Perigo 3: Erosão da Qualidade e da Reputação da Marca

Além de catástrofes discretas, um perigo sutil, mas corrosivo, do uso não treinado da IA é a erosão gradual da qualidade. Quando os colaboradores confiam na IA como uma muleta em vez de uma ferramenta, a qualidade de seu trabalho pode diminuir. Os resultados são frequentemente genéricos, robóticos e carentes de discernimento humano.

A Gannett, uma das maiores editoras de jornais dos EUA, aprendeu isso da maneira mais difícil quando usou uma IA para escrever resumos de esportes do ensino médio. Os artigos eram tão comicamente ruins — usando frases como "encontro do tipo atlético" — que se tornaram motivo de chacota nacional. A empresa alienou os leitores locais e teve que interromper o programa, sofrendo um grande golpe em sua reputação jornalística.

Se os relatórios, textos de marketing ou comunicações com clientes de sua empresa começarem a parecer sem vida e genéricos, você está a caminho da irrelevância da marca. A IA deve aumentar a expertise humana, não substituí-la.

A Solução: Uma Barreira Humana

O fio condutor em todos esses perigos é o erro humano — especificamente, a falta de compreensão da tecnologia. A defesa mais eficaz contra os perigos da IA é uma "barreira humana": uma força de trabalho educada, ciente e capacitada para usar a IA com segurança e eficácia.

Nosso abrangente programa de treinamento é projetado para construir essa barreira. Ensinamos a seus colaboradores:

- As regras inegociáveis de segurança de dados em IA.

- Como identificar e verificar potenciais alucinações de IA.

- Uma estrutura para usar a IA para melhorar a qualidade, não para diluí-la.

- Os casos de uso específicos onde a IA é forte e onde deve ser evitada.

Não espere por uma catástrofe induzida por IA para levar esses perigos a sério. A hora de treinar sua equipe é agora.

Pronto para proteger sua empresa e transformar o risco da IA em uma vantagem competitiva?